7-12 VLM (視覚言語モデル) の開発

学習目標

VLM(Vision-Language Model)は、画像と自然言語の両方を理解できるAIモデルです。視覚情報と言語情報を統合することで、画像キャプション生成や視覚的な質問応答といったマルチモーダルなタスクを実行できます。

VLMの実行効率を向上させるには、LLM(Large Language Model)の量子化が重要なステップとなります。しかし、一部の量子化ツールはJetsonプラットフォームに直接インストールできません。この問題を解決するため、NVIDIAはJetsonコンテナを提供しています。Jetsonコンテナは、様々なハードウェアやJetPackバージョンに対応した互換性のあるコンテナ環境を提供し、デプロイメントを簡素化し、開発を加速させます。

初期環境設定

// If you encounter any Docker-related errors, please refer to the tutorial in Chapter 5

git clone https://github.com/dusty-nv/jetson-containers

bash jetson-containers/install.sh

イメージをダウンロードして起動します

sudo jetson-containers run $(autotag nano_llm)

VLMを実行する

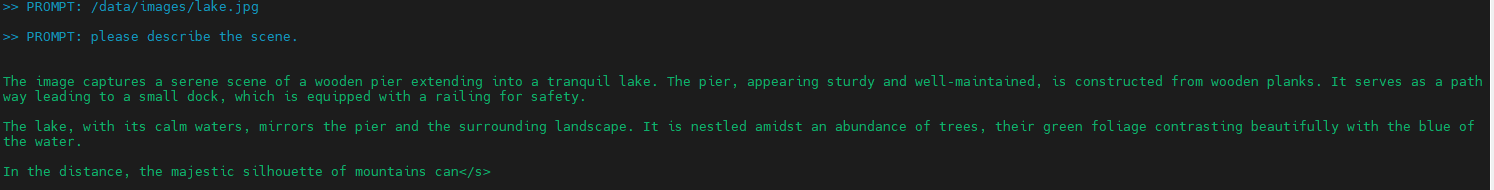

// The results will be displayed directly in the terminal

python3 -m nano_llm.chat --api=mlc \

--model Efficient-Large-Model/VILA1.5-3b \

--prompt '/data/images/lake.jpg' \

--prompt 'please describe the scene.'

jetson-containers/data/imagesフォルダは、説明したい画像を配置できる場所です。--prompt引数を対応する画像ファイル名で更新してください。例:--prompt '/data/images/lake.jpg'